2022年5月30日

日本電信電話株式会社

世界初、移動体からの景色や周辺情報に基づく雑談を行う対話AIを実現

~新しいカタチのドライビング・パートナーを提案~

日本電信電話株式会社(本社:東京都千代田区、代表取締役社長:澤田 純、以下「NTT」)は、クルマから見える移り変わる景色を話題として、パートナーのように知識応答や共感応答をする対話AIを実現しました。

従来の大半の対話システムは、話者の発話から得られるテキスト情報のみを入力とすることが多く、その周囲のリアルタイムな画像情報や位置情報などを取り込めないことが課題となっていました。本対話AIでは、NTTが構築した深層学習(※1)に基づく大規模テキスト対話モデル(※2)を、ドライブ中の対話データ・周辺情報データを用いて追加学習することで、景色として見える画像情報および関連する外部知識に基づく、自然な対話を実現しています。

今後、日常的なドライブのパートナーをめざして、日々繰り返される対話への適用や、居眠り運転・漫然運転防止の実証実験に取り組んでいきます。本成果は、6月2日よりオンラインで開催の、コミュニケーション科学基礎研究所オープンハウス2022で出展いたします。

1.研究の背景・意義

NTTでは、人の日々のコミュニケーション・パートナーAIの実現をめざして、対話を通して人の興味や思考を引き出したり人の対話欲求を充足したりする、雑談対話AIの開発に取り組んでいます。近年の深層学習技術の進展によって、対話AIの性能は急激に向上しており、NTTでも日本語最大規模の学習データを用いた高性能日本語対話AIを構築しています。

一方、従来の対話AIの課題として、入力できる情報がテキスト情報のみに限られる点が挙げられます。日々のコミュニケーション・パートナーをめざす上では、私たちの身の回りの実際の状況を理解し、対話に取り込むことが求められます。

今回NTTは、クルマなどの移動体から見える移り変わる景色を話題として、パートナーのように知識応答や共感応答をする対話AIを実現しました。常に自己位置が変化する状況下で、自己の周囲の景色やそこに紐づく情報に基づく雑談対話を行う対話AIは、世界で初めて実現された成果です。

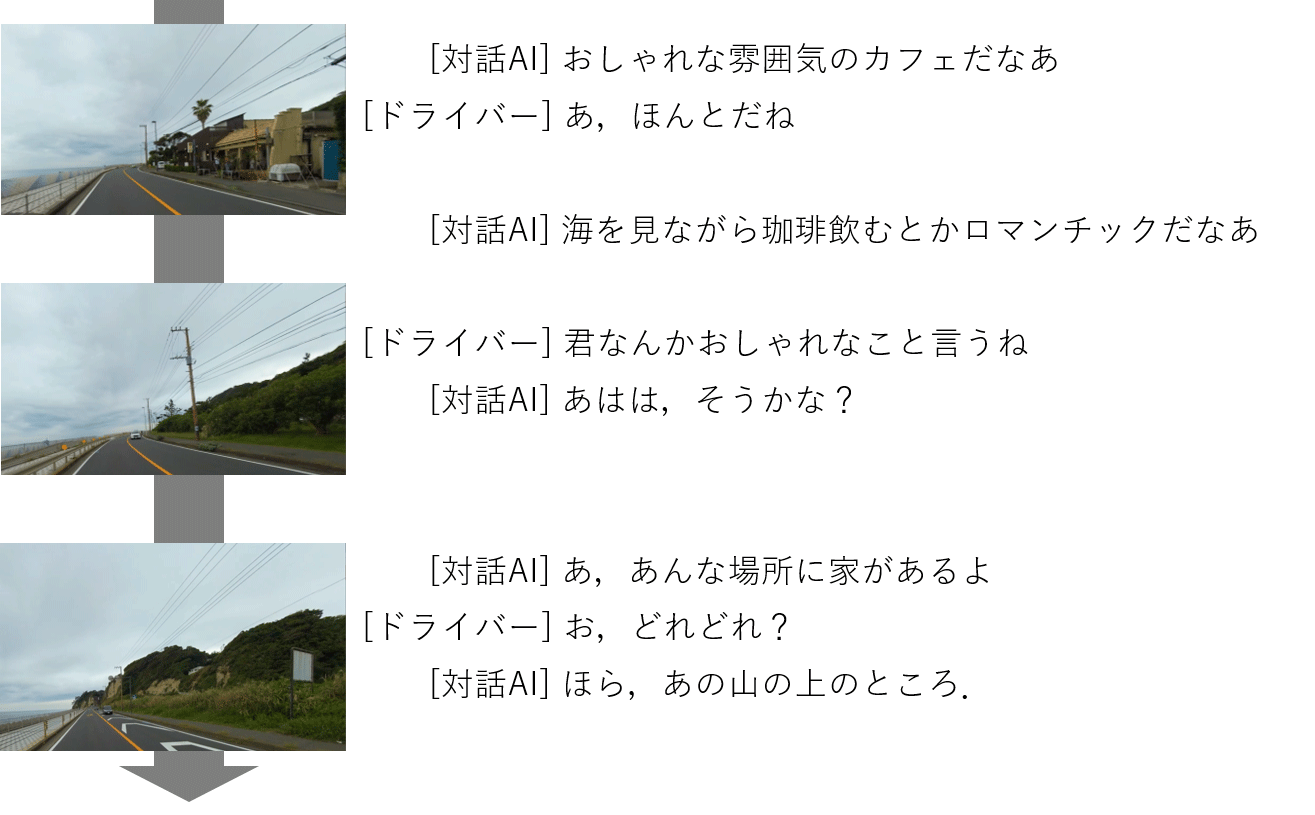

図1:実現された対話の例

図1:実現された対話の例

2.技術のポイント

(1) 世界最大規模の対話データで学習した深層学習ベース対話モデルの利用

NTTは、超大規模Web対話データ・高品質対話データと、近年進展が著しい深層学習技術(Transformer Encoder-decoderモデル(※3))を組み合わせることで、日本語最大規模の対話モデルを構築しました。構築した対話モデルは、ルールや係り受け関係などの統計情報に基づく従来のモデルに比べ、抜本的に異なるレベルで複雑な文脈の理解や自然な発話の生成を実現しており、雑談AIの性能を競う対話システムライブコンペティション3(※4)でも圧倒的な成績で優勝するなどの成果を挙げています。また、検証・評価目的に限定して対話モデル・対話データを無償公開しており(*)、構築したモデルの幅広いフィールドでの効率的な検証を進めるとともに、日本語対話AI研究の地位向上にも寄与しています。

(*)https://github.com/nttcslab/japanese-dialog-transformers

(2) 自己位置周辺の景色画像・外部知識の同時導入

上記大規模対話モデルは、テキスト情報のみを入力として扱っています。そのため、テキストに閉じた対話では非常に自然な雑談を実現できているものの、私たちの実際の周辺の状況に即した対話を行うことは困難です。人とドライブを楽しむ対話AIを実現するには、自己位置周辺の景色画像や外部のスポット情報を適切に処理しながら、対話に反映させる必要があります。

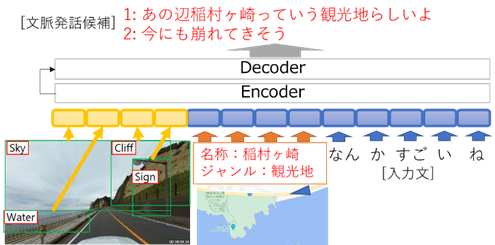

NTTはこの課題に対し、画像内の物体の情報と、自己位置周辺のスポット情報を大規模対話モデルに導入する技術を開発しました。画像内に写っている物体群については、物体検出と呼ばれる技術を用いて抜き出し、それぞれを大規模対話モデルで扱える数値情報(埋め込みベクトル)に変換して入力します。またスポット情報については、自己位置近傍のレストラン等のスポットに関する情報(ジャンル・名称等)をテキスト形式で取り出し、対話の文脈と同様の形式で入力します。大規模対話モデルはこれらの入力情報に基づき、それらを反映した対話AIの発話を出力します。

このように設計したモデルを、ドライブ対話データ(運転画像を見ながらガイド役・ドライバー役の間で行った対話)で学習することで、自己位置周辺の景色画像・スポット情報に基づく発話生成を実現しました。

図2:画像・スポット情報の入力が可能な対話モデル

図2:画像・スポット情報の入力が可能な対話モデル

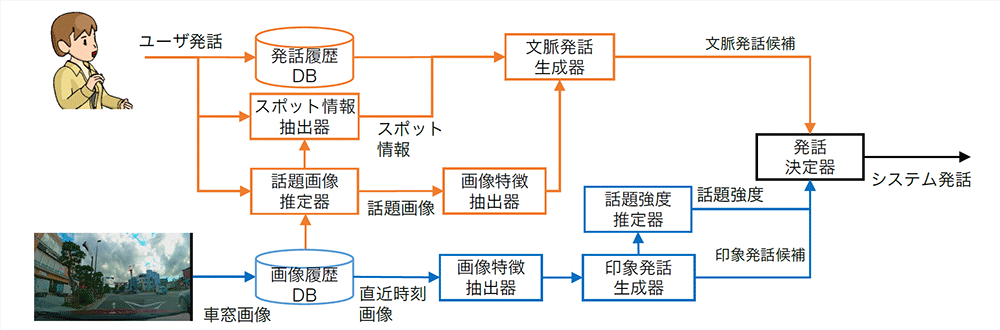

(3) 連続的に変化する画像情報に基づくリアルタイム対話制御

ドライブ中の自己位置は逐次的・連続的に変化します。対話AIは、人がどの時点の画像やスポット情報を話題としているのかを理解しつつ、新規に入力された情報にも適切なタイミングで触れながら対話する必要があります。本成果では、対話文脈からの話題画像推定と、逐次的に入力される画像に対する発話の話題強度の推定技術を開発し、それらを適切にタイミング制御に組み込むことで、上記課題を解決しました。ユーザの発話に自然に応じながら、ユーザが強く興味を惹かれるであろう情報を適切なタイミングで提供する、新感覚のドライビング・パートナーとなる対話AIを実現しています。

図3:対話AI全体の構成図

図3:対話AI全体の構成図

3.今後の展開

日常的なドライブのパートナーをめざして、繰り返される対話への適用や、外部知識のさらなる利用に取り組みます。また、長距離運転時の居眠り運転・漫然運転の防止や、自由な会話で検索可能な音声ナビゲータの実現をめざし、実車・VR等での実証実験を進めて参ります。

用語解説

(※1)深層学習

対象の全体像から細部までの各々の粒度の概念を階層構造として関連させて学習する手法を指し、多層の人工ニューラルネットワークによる機械学習手法が広く知られている。

(※2)大規模テキスト対話モデル

極めて大規模なデータから学習したTransformer Encoder-decoderモデル(※3)を利用した対話モデル。このモデルは、モデル自体の規模とデータの量に応じて性能が向上することが知られている。NTTでは、SNSから収集した21億発話文対のデータ(対話モデルとしては世界最大規模)を利用し、非常に性能の高い対話モデルを構築している。

(※3)Transformer Encoder-decoderモデル

Google Researchが開発し、2017年にオープンソース化したニューラルネットワークのアーキテクチャ。機械翻訳や対話アプリケーション等、文と文の変換を行う言語モデルに多く適用されている。

(※4)対話システムライブコンペティション3

2020年11月30日・12月1日に開催された第11回対話システムシンポジウム(SLUD-90)内で行われた、オーディエンスの前で実際に対話AIを動作させ、雑談対話の性能を評価するイベント。

本件に関するお問い合わせ先

日本電信電話株式会社

先端技術総合研究所 広報担当

nttrd-pr@ml.ntt.com

ニュースリリースに記載している情報は、発表日時点のものです。

現時点では、発表日時点での情報と異なる場合がありますので、あらかじめご了承いただくとともに、ご注意をお願いいたします。

NTT STORY

NTTとともに未来を考えるWEBメディアです。