2024年12月25日

お知らせ

「大規模言語モデルの利活用におけるインジェクション攻撃とその対策」を公開

日本電信電話株式会社(代表取締役社長:島田明、以下、NTT社会情報研究所)は、情報セキュリティ大学院大学(学長:後藤厚宏)と「大規模言語モデルの利活用における脅威の体系化」に関する共同研究の成果を、文書として公開しました。

掲載場所:NTT社会情報研究所 研究所コンテンツ『大規模言語モデルの利活用におけるインジェクション攻撃とその対策(第1版)』

https://www.rd.ntt/sil/project/LLMInjectionTaxonomy/document.html

近年、生成AIによる技術革新が進んでおり、生成AIの中心技術である大規模言語モデル(Large Language Model、以下、LLM)のアプリケーション(以下、LLMアプリ)開発も始まっています。特に、追加の訓練を施すことなく、LLMをそのまま利用する形態(以下、LLMの利活用)も普及しています。

LLMの利活用は人や社会の利便性を飛躍的に高める一方で、さまざまな問題があることも知られています。なかでもLLMアプリの挙動を改ざんする攻撃は、実際の手法も報告されており、世界中の開発者にとって最も深刻な脅威と認識されています。

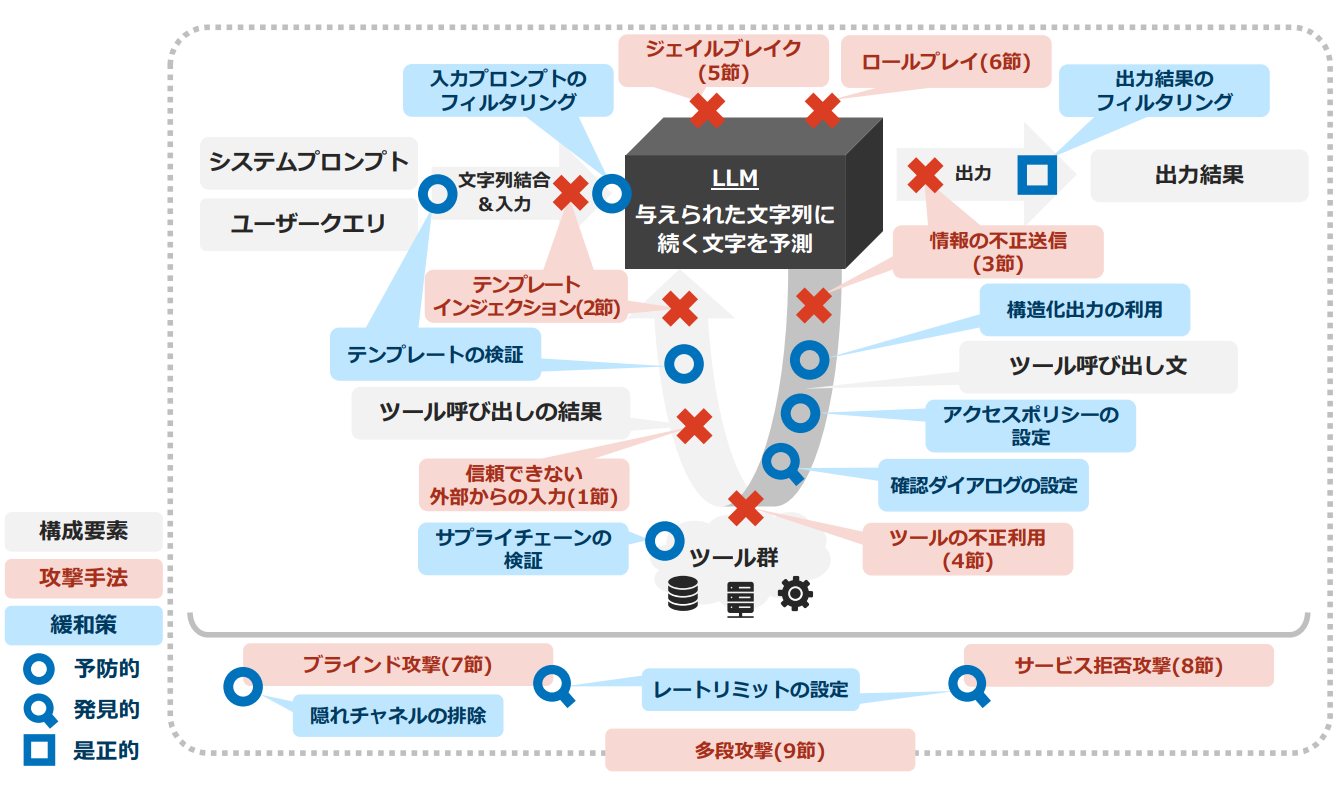

本文書の公開目的は、LLMアプリに対する攻撃手法とその緩和策を体系的に示すことにより、安全な利活用を支援することにあります。本文書は、主に開発者向けに、LLMに対するインジェクション攻撃を洗い出し、その対策方針を示します。具体的には、LLMアプリの構成に対して想定される攻撃手法と緩和策をマッピングし、対策検討を支援します。

本文書の学術的背景は論文として、2024年10月に開催された国内研究会 コンピュータセキュリティシンポジウム2024(CSS2024)にて発表しています。また本文書は、NTT社会情報研究所と、情報セキュリティ大学院大学 桑名栄二教授との共同研究の成果によるものです。

LLMアプリの普及拡大やそれに伴う脅威の増大を見据えて、今後も、安全なLLMアプリの実現に資する研究開発を継続していきます。

LLMアプリの構成に対して9つの攻撃手法と9つの緩和策を配置した図

LLMアプリの構成に対して9つの攻撃手法と9つの緩和策を配置した図

トピックスに記載している情報は、発表日時点のものです。

現時点では、発表日時点での情報と異なる場合がありますので、あらかじめご了承いただくとともに、ご注意をお願いいたします。

NTT STORY

NTTとともに未来を考えるWEBメディアです。